做网站简单需要什么百度数据研究中心官网

整理并翻译自DeepLearning.AI×LangChain的官方课程:Memory

Memory

使用open ai的API调用GPT都是单次调用,所以模型并不记得之前的对话,多轮对话的实现其实是将前面轮次的对话过程保留,在下次对话时作为输入的message数组的一部分,再将新一轮对话的提问也放入message数组,再发起一次API调用,即构手动建对话流(以上笔者注)。

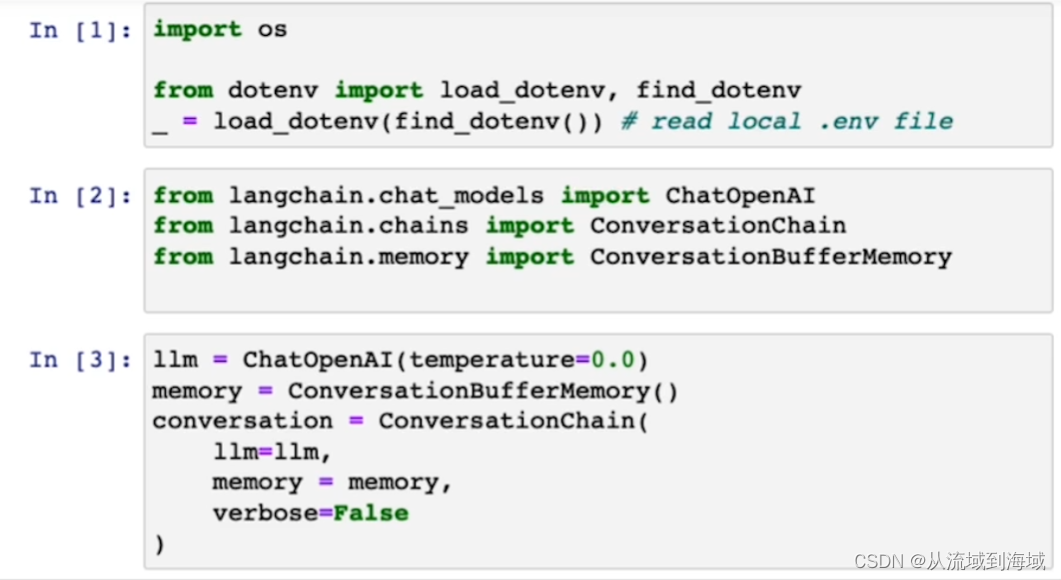

构建对话流(LangChain称作对话链)可以使用LangChain提供的memory(记忆)这个组件来实现,本节就是例子:

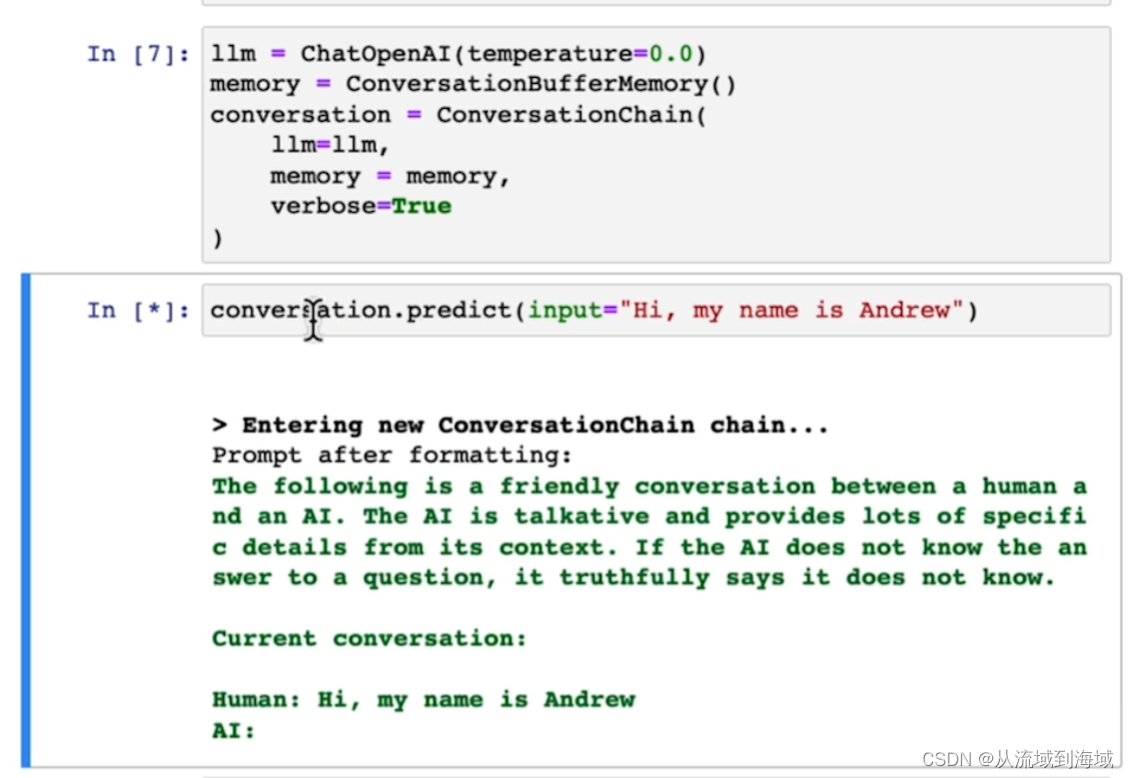

设置verbose标志为true能看到完整的对话链:

能看出LangChain的ConversationChain其实默认提供了一个提示词,该提示词简单设定了对话场景和GPT扮演的角色AI,并要求GPT在不知晓问题答案时老老实实回答不知道以杜绝幻觉现象。

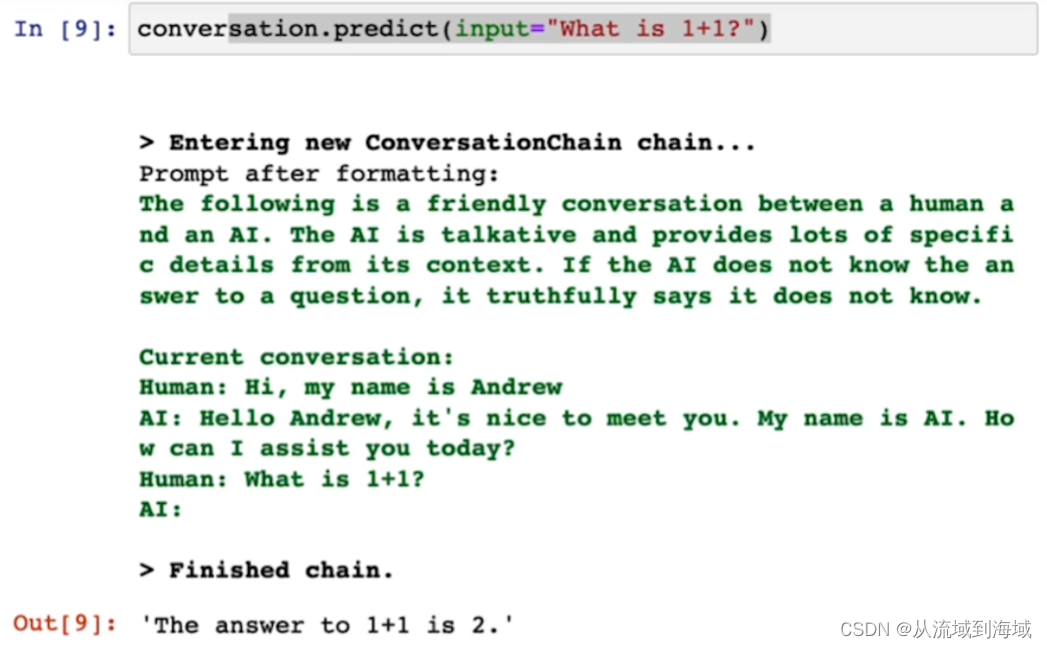

继续提问第二个问题“What is 1+1”

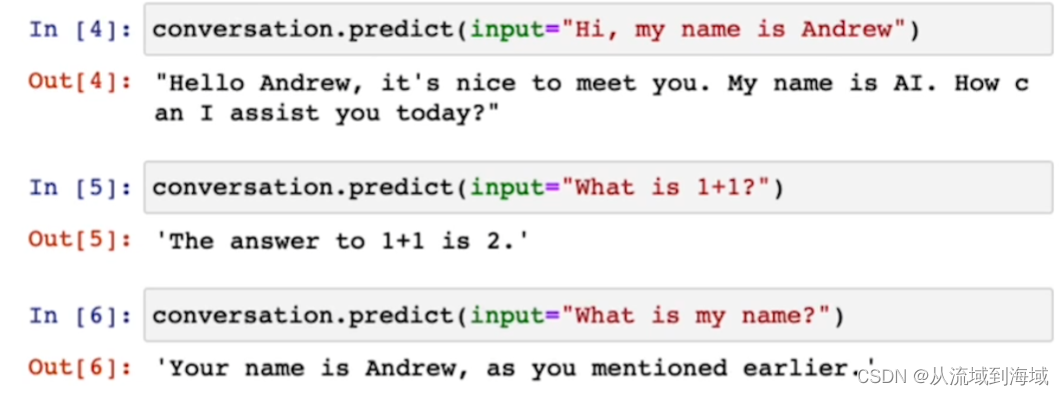

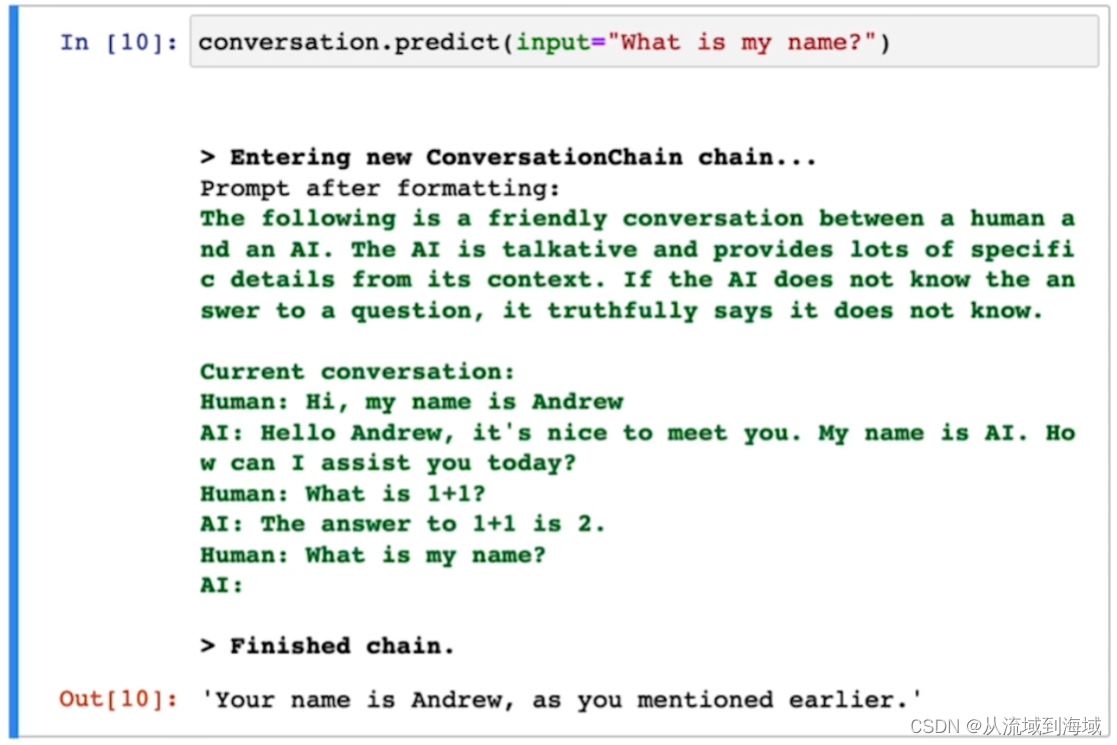

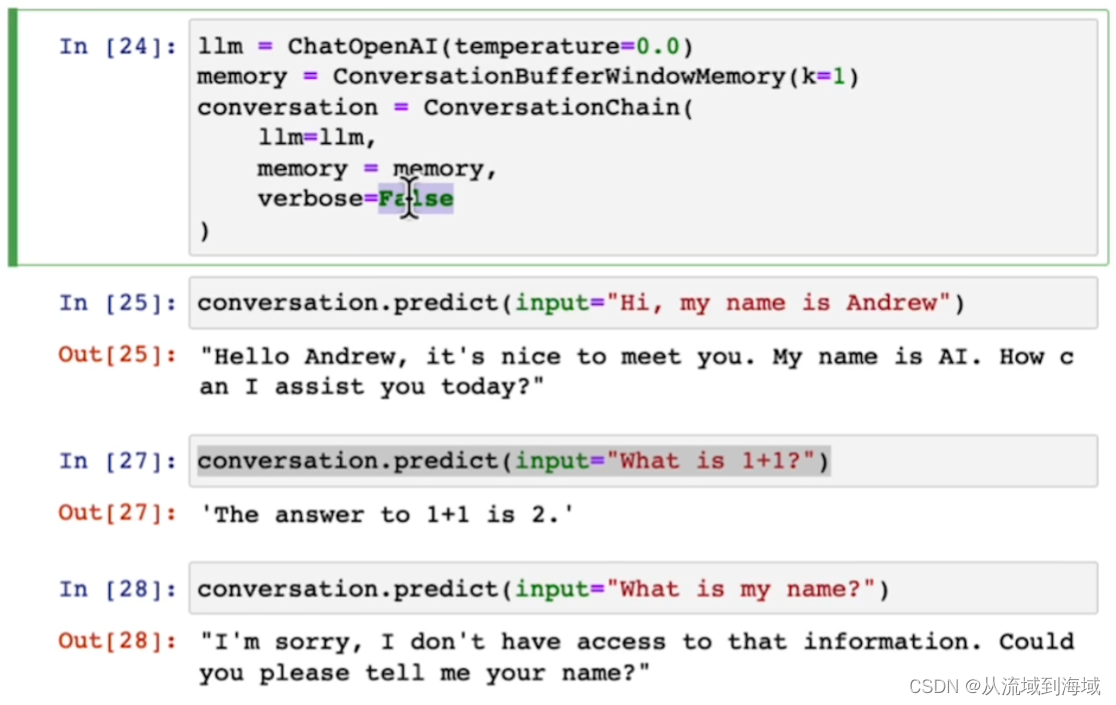

继续提问第三个问题“What is my name?”

可以看到,对话历史不断累积,输入也变得越来越长

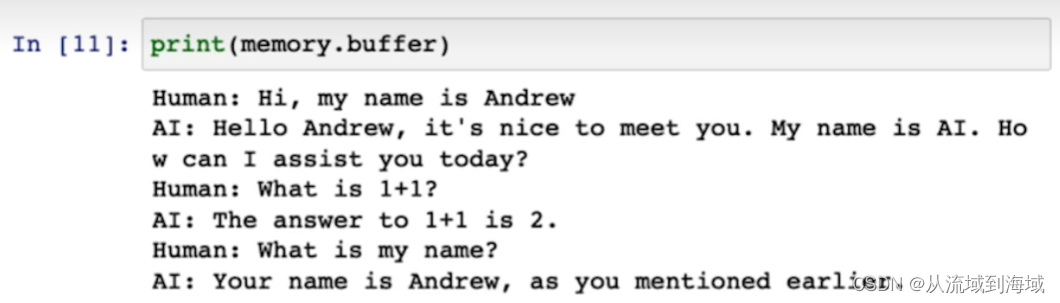

memory.buffer内存储了所有的对话历史,不含输入提示词的其他部分。

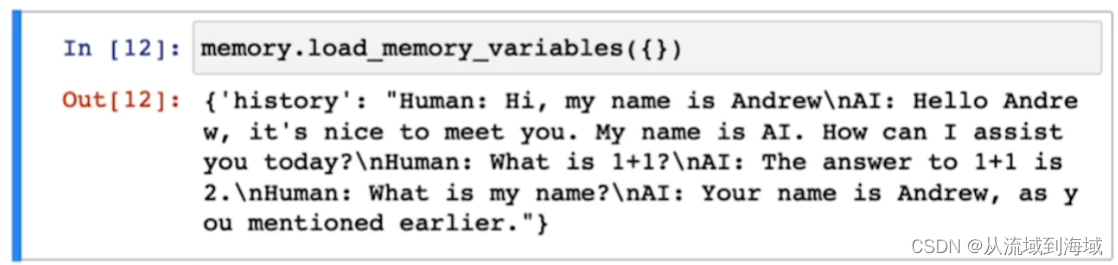

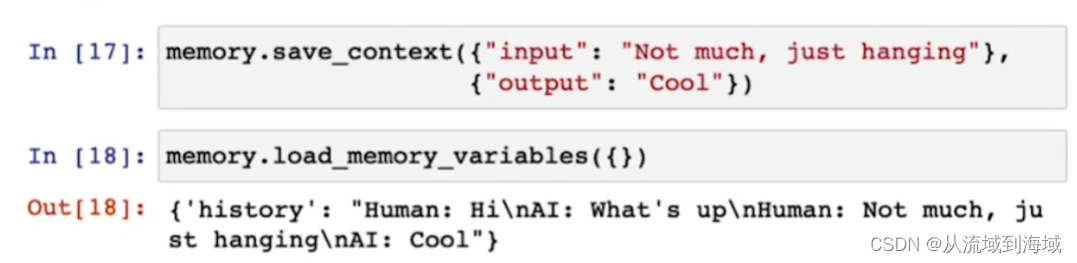

使用memory的load_memory_variables()方法可以看到,memory维护一个变量字典,其中有一个名为history的变量存储了对话历史。

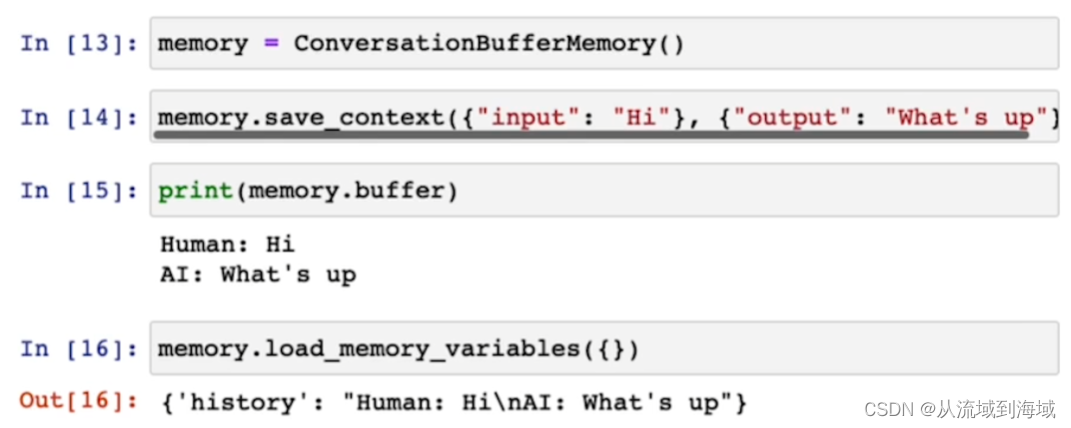

可以直接使用memory的save_context方法构建对话历史(笔者注:此时对话历史中AI的回答是人为指定的,不是真实的GPT回复,这里是为了演示,实际使用时不推荐这么做,GPT的真实回复可能和指定的不同,并没有完全使用GPT)。

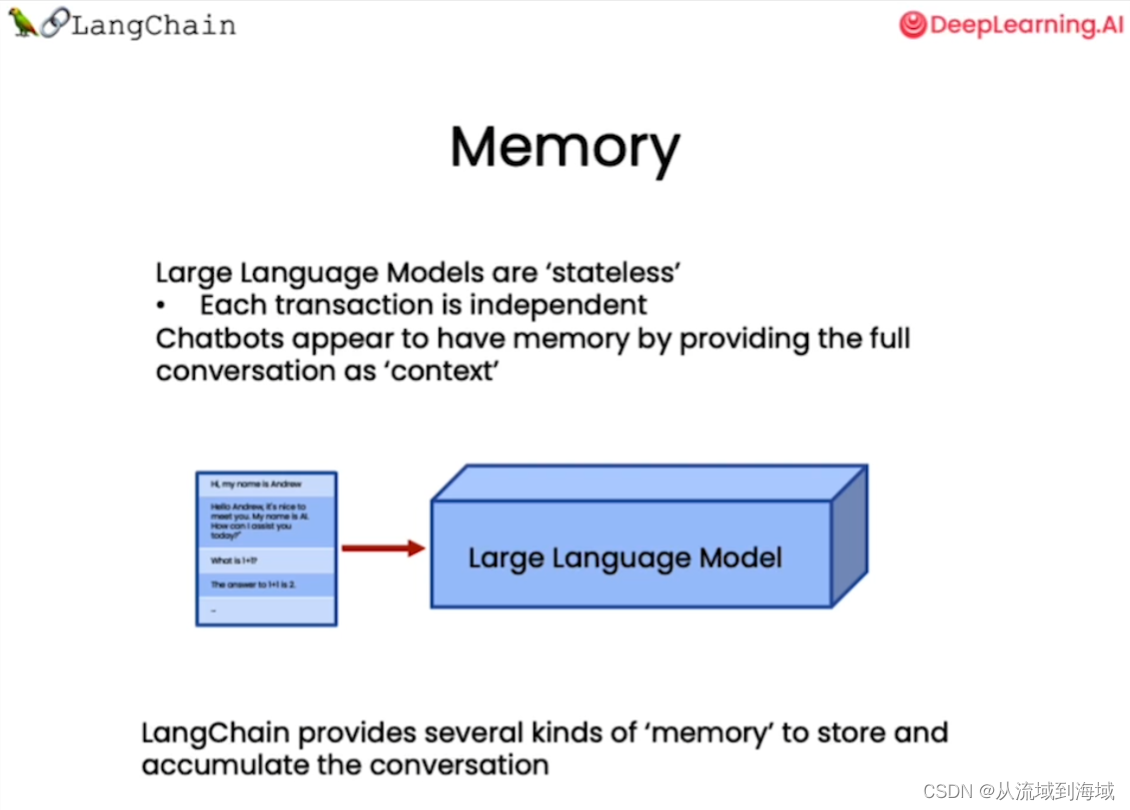

Memory(记忆)

大语言模型是无状态的

- 每一个对话都是独立的

对话机器人表现出记忆能力其实是因为实现的时候将整个对话作为上下文输入给了大语言模型

LangChain提供了多种类型的memory来存储和累积对话。

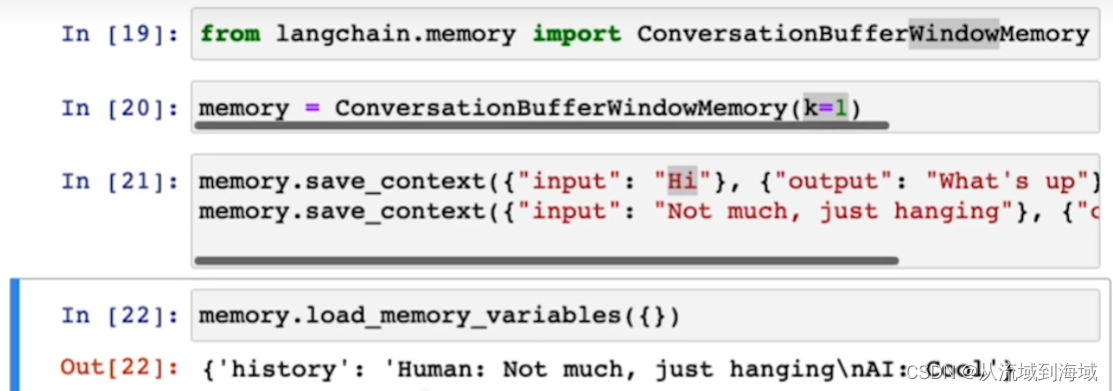

ConversationBufferWindowMemory可以指定memory的的缓存大小(以对话轮数为单位):

k=1仅存储一轮对话作为历史,上上轮对话将会丢失:

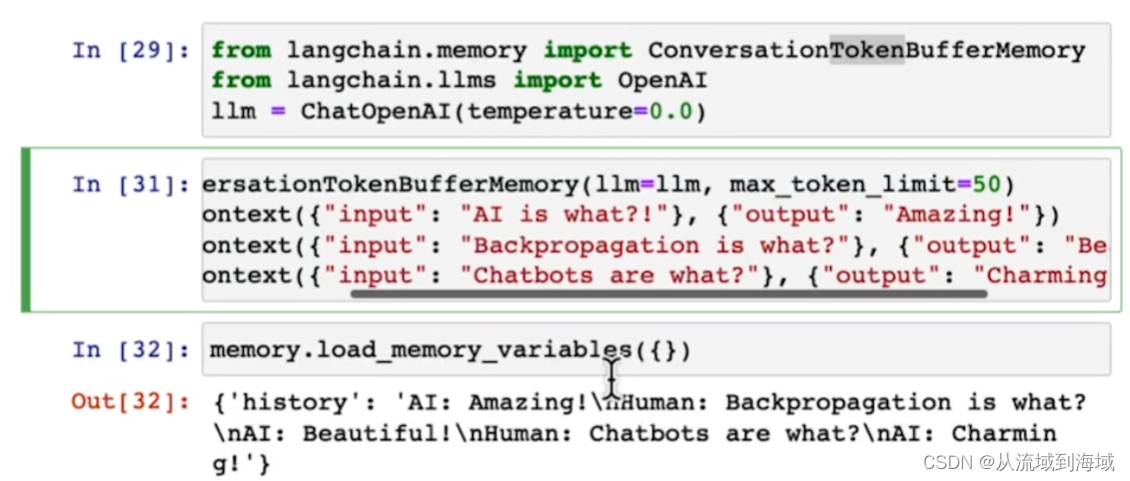

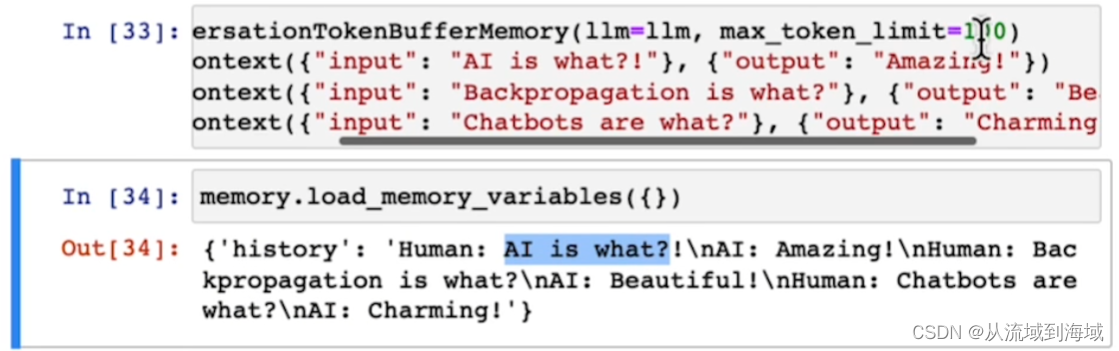

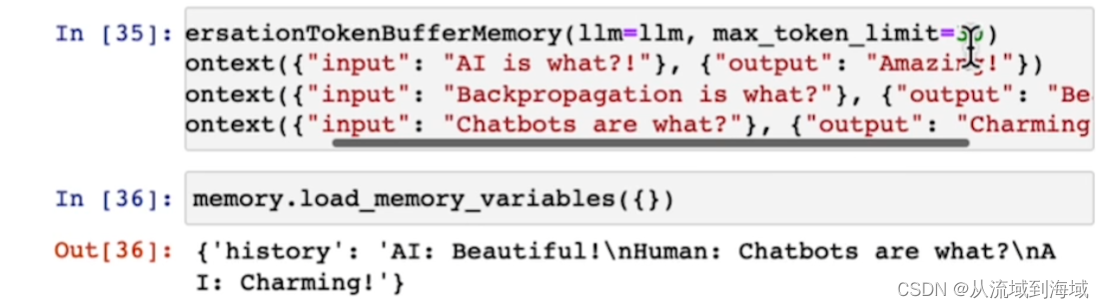

ConversationTokenBufferMemory可以指定memory的token数量(笔者注:这个比较实用,因为GPT有最大token数限制,同时也是按token数计费的)。

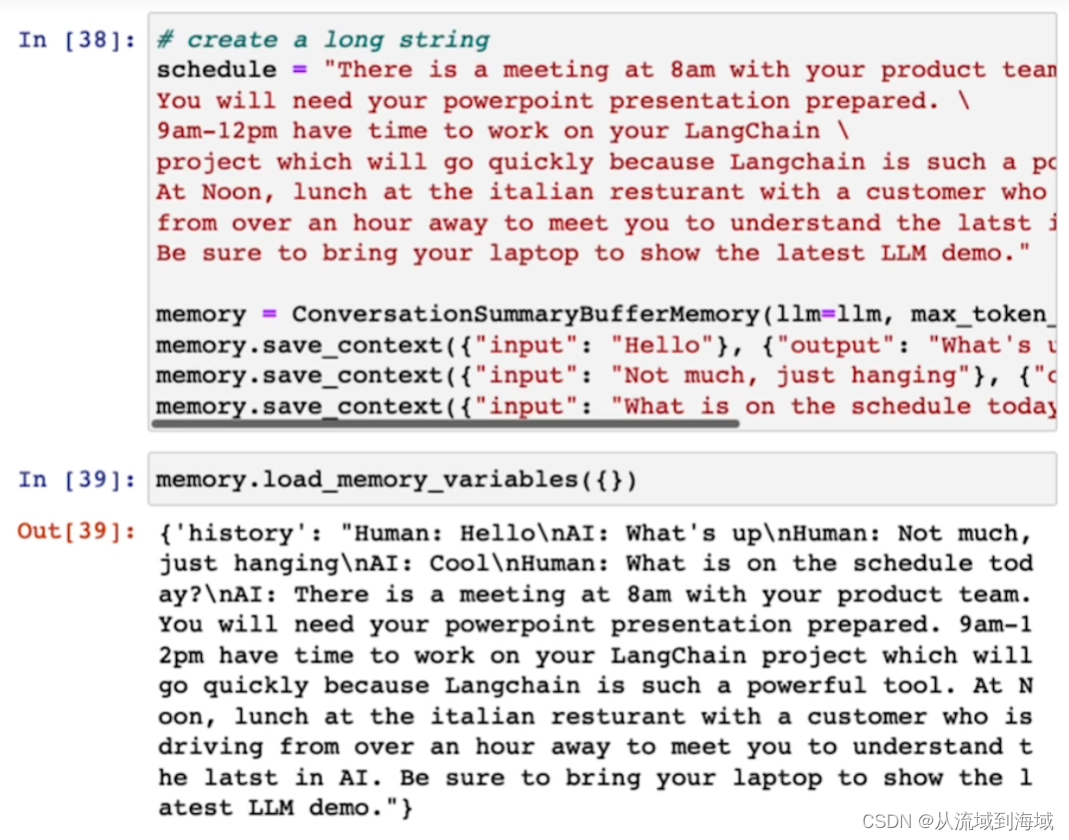

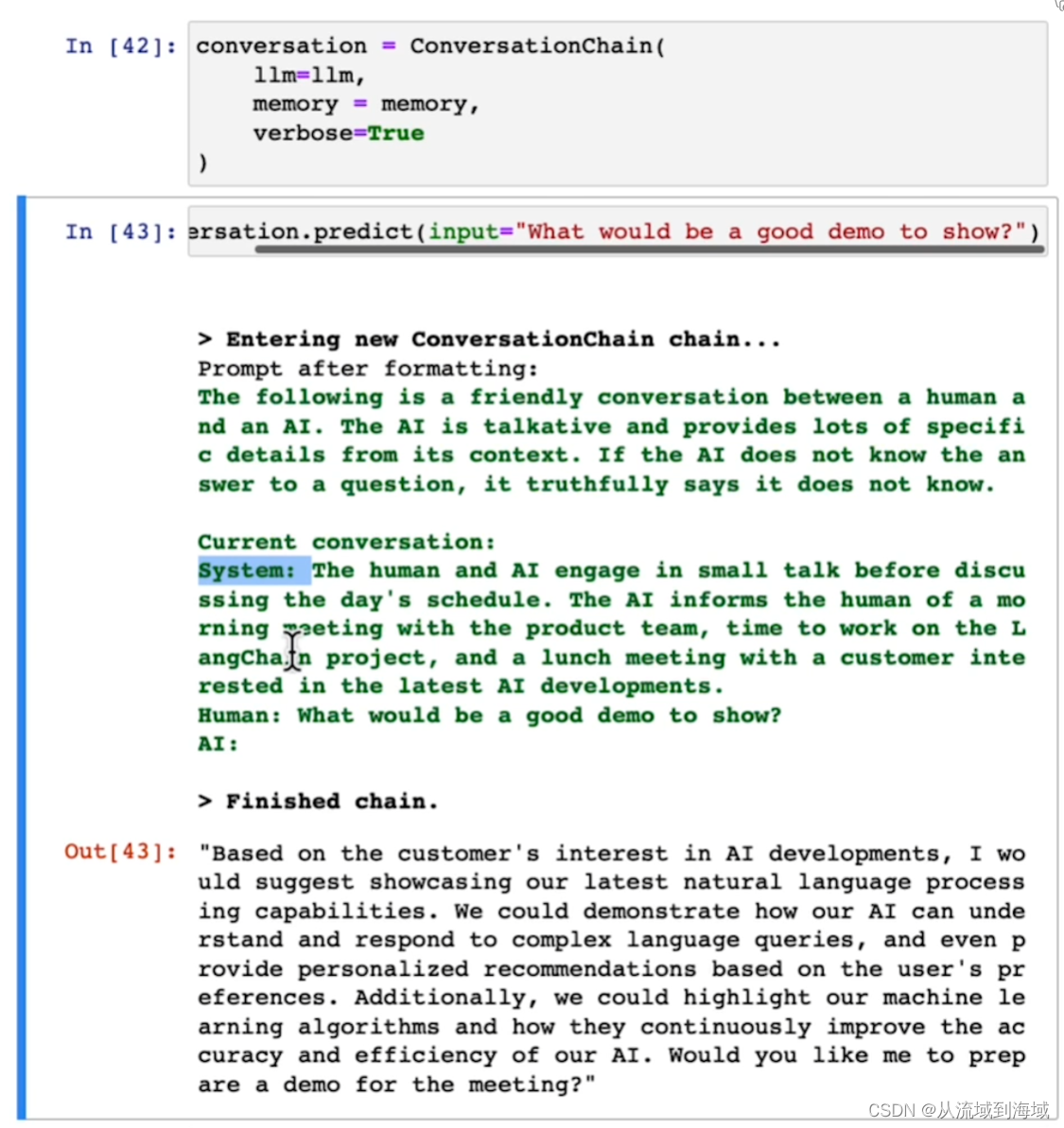

ConversationSummaryBufferMemory可以将对话以摘要的形式存储:

上图中max_token_limit=400,足够存储整个对话历史,如果我们将max_token_limit=100,将会触发以摘要形式存储对话历史来满足最大token数限制:

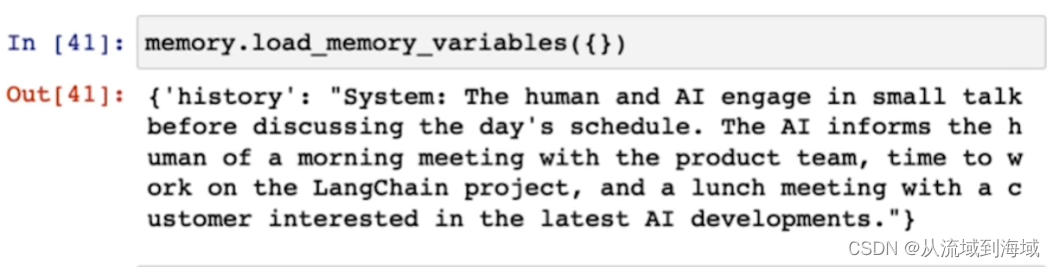

尝试使用摘要对话历史提问:

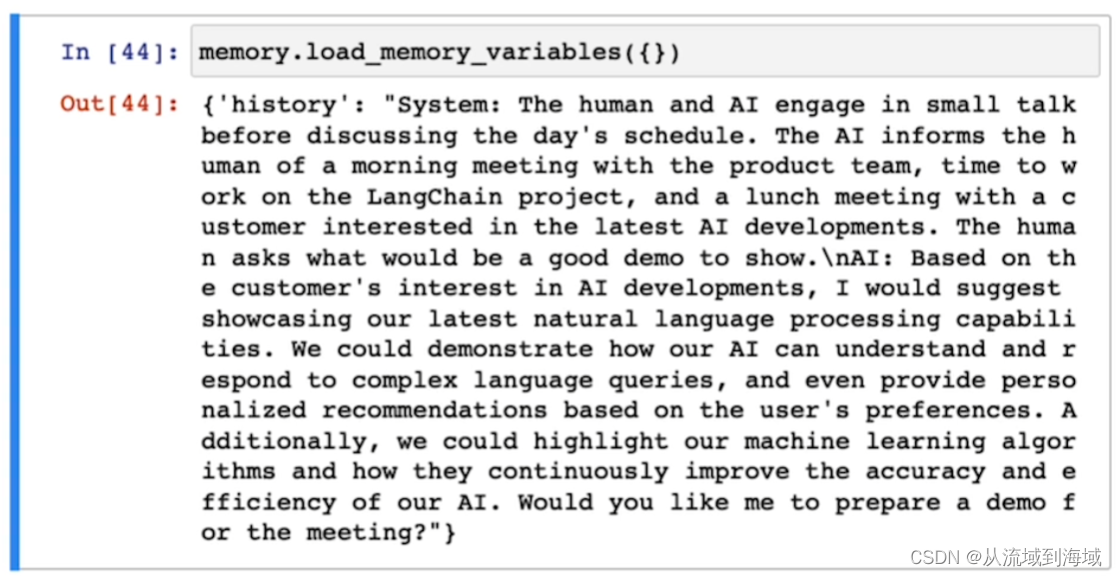

可以回答的不错,查看对话历史:

发现LangChian将提问内容摘要在System角色里面(和GPT API的system不是同一个,但使用了同样的名称)以满足最大token数限制。

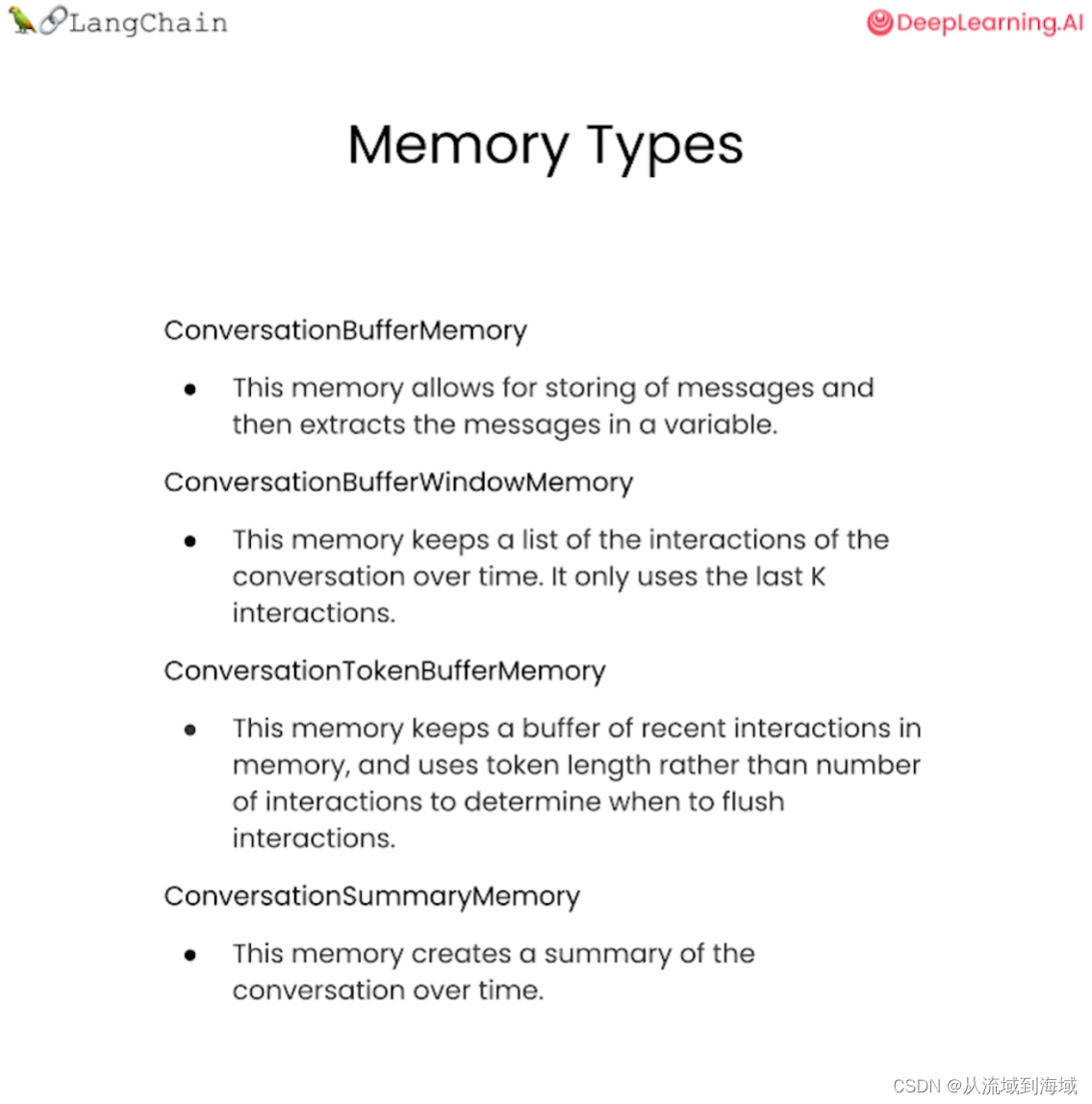

Memory类型

ConversationBufferMemory

- 该类型

memory在一个变量中存储和提取对话信息

ConversationBufferWindowMemory

- 该类型

memory存储将随时间进行的对话交互以列表的形式存储,但仅存储k轮对话

ConversationTokenBufferMemory

- 该类型

memory存储最近的对话交互,并且使用token长度而不是对话论述来决定是否刷新对话交互历史

ConversationSummaryMemory

- 该类型

memory存储随时间进行的对话的摘要

更多memory类型

Vector data memory(向量数据memory)

- 在一个向量数据库中存储从对话(或者其他途径)获得的文本,查询时检索和文本最相关的块

Entity memory(实体memory)

- 使用一个LLM,它可以记住某个实体的详细信息

可以同时使用多种memory,例:对话memory + 实体memory来回忆个人信息

也可以将对话保存在传统数据库中,比如key-value存储或者SQL。